前一段時間我向大家介紹了開源 AI 繪圖模型 FLUX.1,它生成的圖片效果令人驚豔,細節處理、指令理解能力都非常出色,雖然與 Midjourney V6.1 相比略遜一籌,但依舊是目前最頂尖的一匹模型。

今天就來跟大家如和在自己的電腦上使用。整個過程非常簡單,電腦小白也可以輕鬆操作,而且即便是 VRAM 較少的顯卡,如 4GB / 6GB VRAM等也可以運行,使用 FLUX.1 生成精美的圖片!

4GB / 6GB VRAM 顯卡也能玩 FLUX.1 的秘密

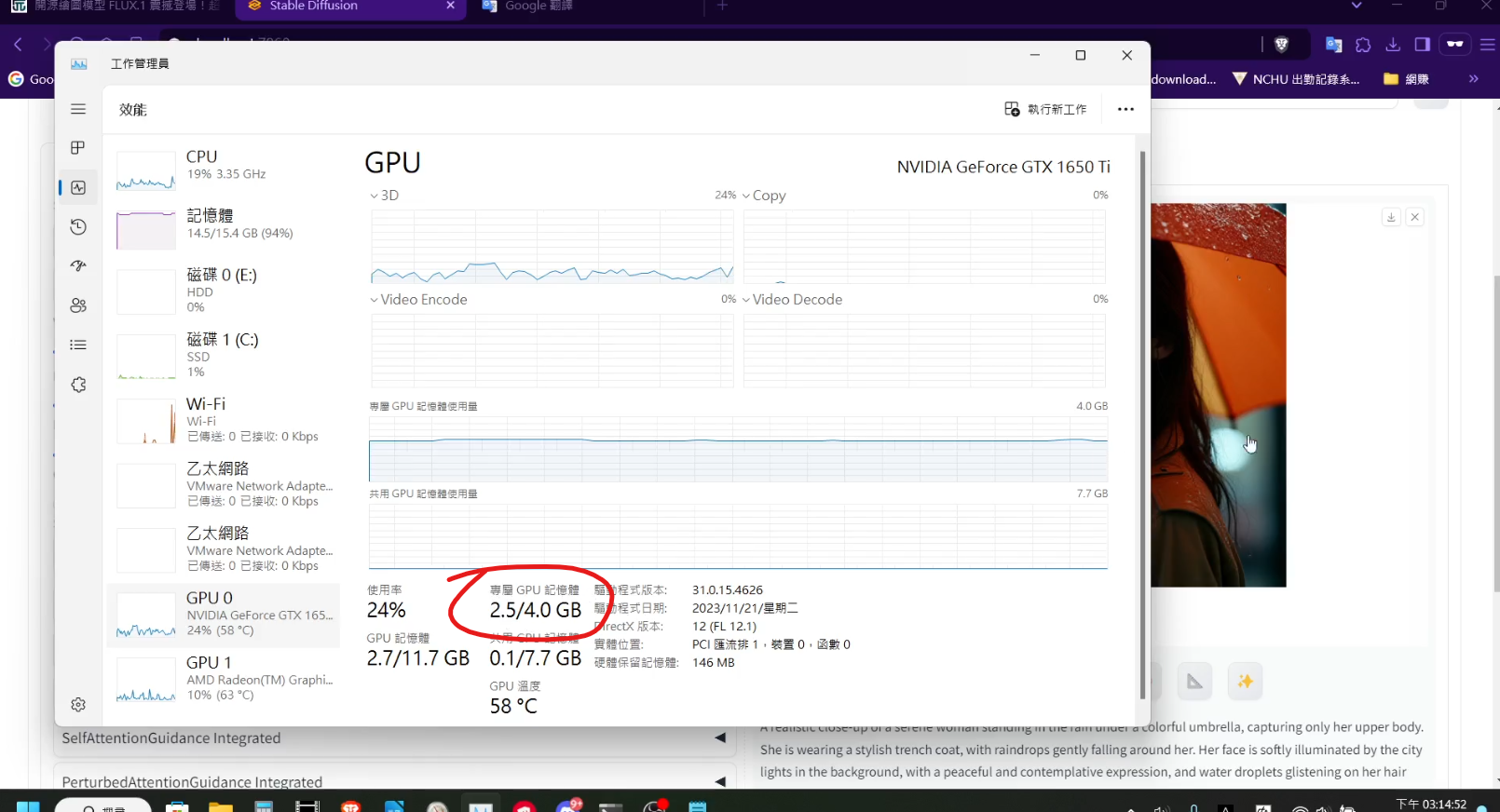

你沒聽錯!即使電腦只有 4GB VRAM 的顯卡,也能夠體驗 FLUX.1 的強大功能。雖然圖片可能只能使用 512×512 這種較低的解析度,但基本上能夠算是順暢的使用 FLUX.1 模型。

在我這台電腦的筆電版 1650 Ti 這個 4 年前發布僅有 4GB VRAM 的顯卡上,約 3 分半即可生成一張圖。若使用較新一點的顯卡,速度必然能更快,擁有 6GB 以上 VRAM 的顯卡,解析度調 1024×1024 應該不成問題。

至於為何能做到在 VRAM 較少的顯卡上執行 FLUX.1,重點就在於使用經過 NF4 量化 的 FLUX.1 模型,以及為效能優化設計過的 Stable Diffusion WebUI Forge。

兩大關鍵:WebUI 和 NF4模型

今天我所要介紹的本機運行 FLUX.1 方法,主要有兩個關鍵:

-

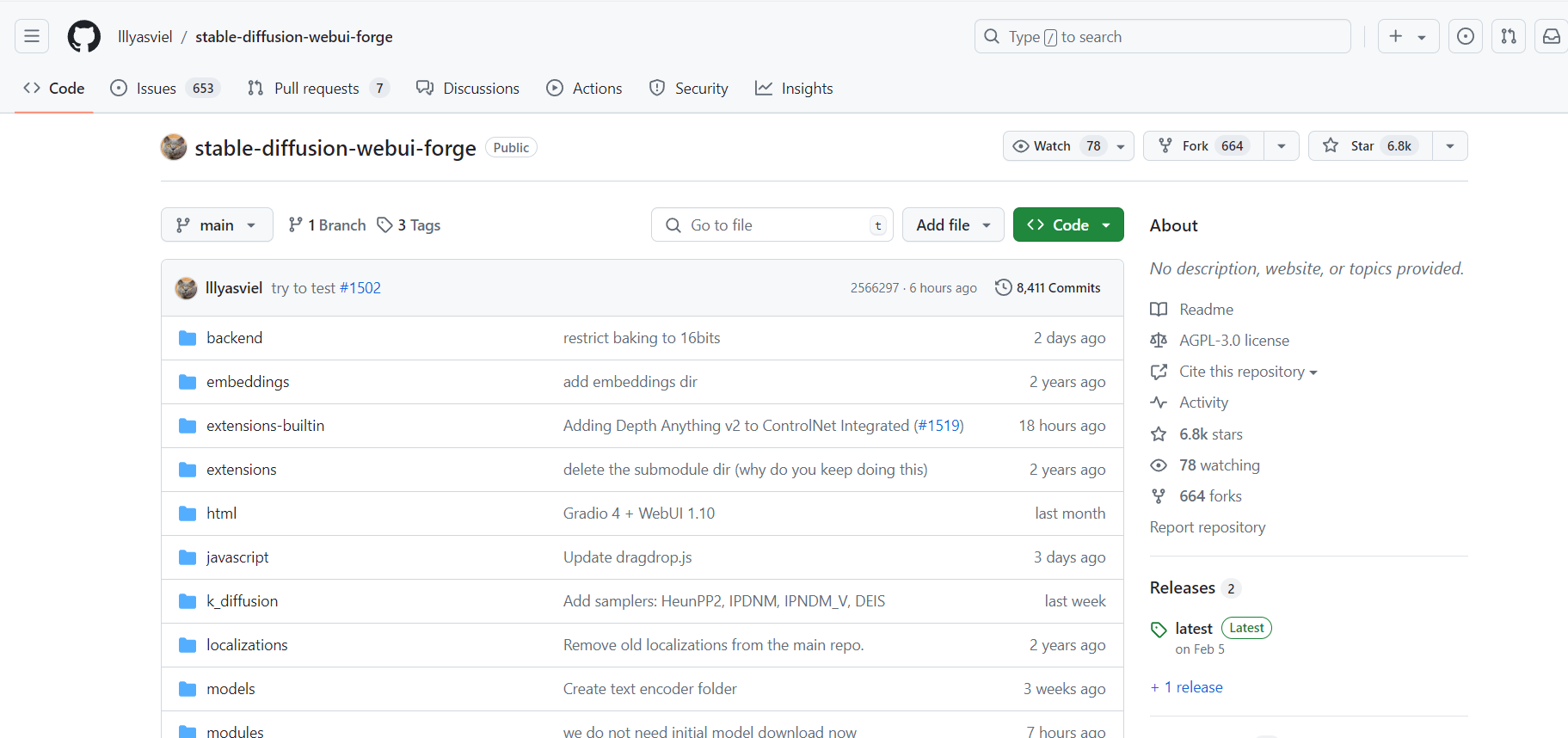

執行介面: 我們會使用由 lllyasviel 大神開發的 Stable Diffusion WebUI Forge,它基於 Automatic1111 的 Stable Diffusion WebUI 改良,操作簡便,且對顯卡效能進行了優化,生成速度更快。也有提供一鍵安裝包。

-

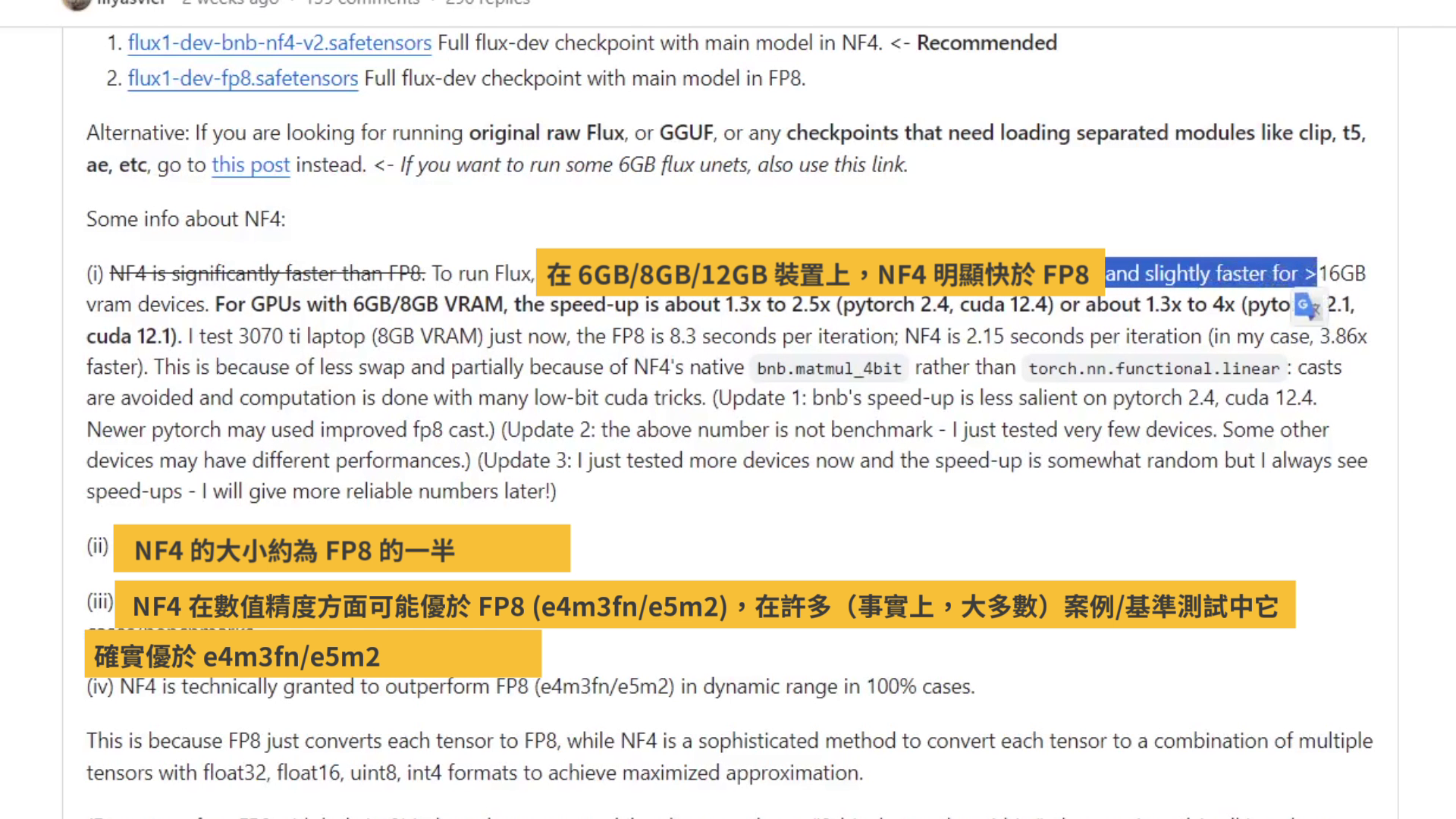

NF4 量化模型: 我們需要下載經過 NF4 量化的 FLUX.1 模型,才能在低 VRAM 顯卡上順暢運行。NF4 量化過後的模型比 fp8 還要更小,但卻有同等、或甚至更高的精度,非常適合所有人使用。

NF4 模型介紹:

https://github.com/lllyasviel/stable-diffusion-webui-forge/discussions/981#Flux%20Checkpoints

另外,雖然 NF4 模型也可以在 ComfyUI 中使用,但鑑於 ComfyUI 較為複雜,所以今天我才會選擇跟大家介紹使用 SD WebUI Forge 的方法。

Step-by-Step 教學

接下來,就讓我們一步一步來看如何快速設定,輕鬆的在自己的電腦上使用 FLUX.1!

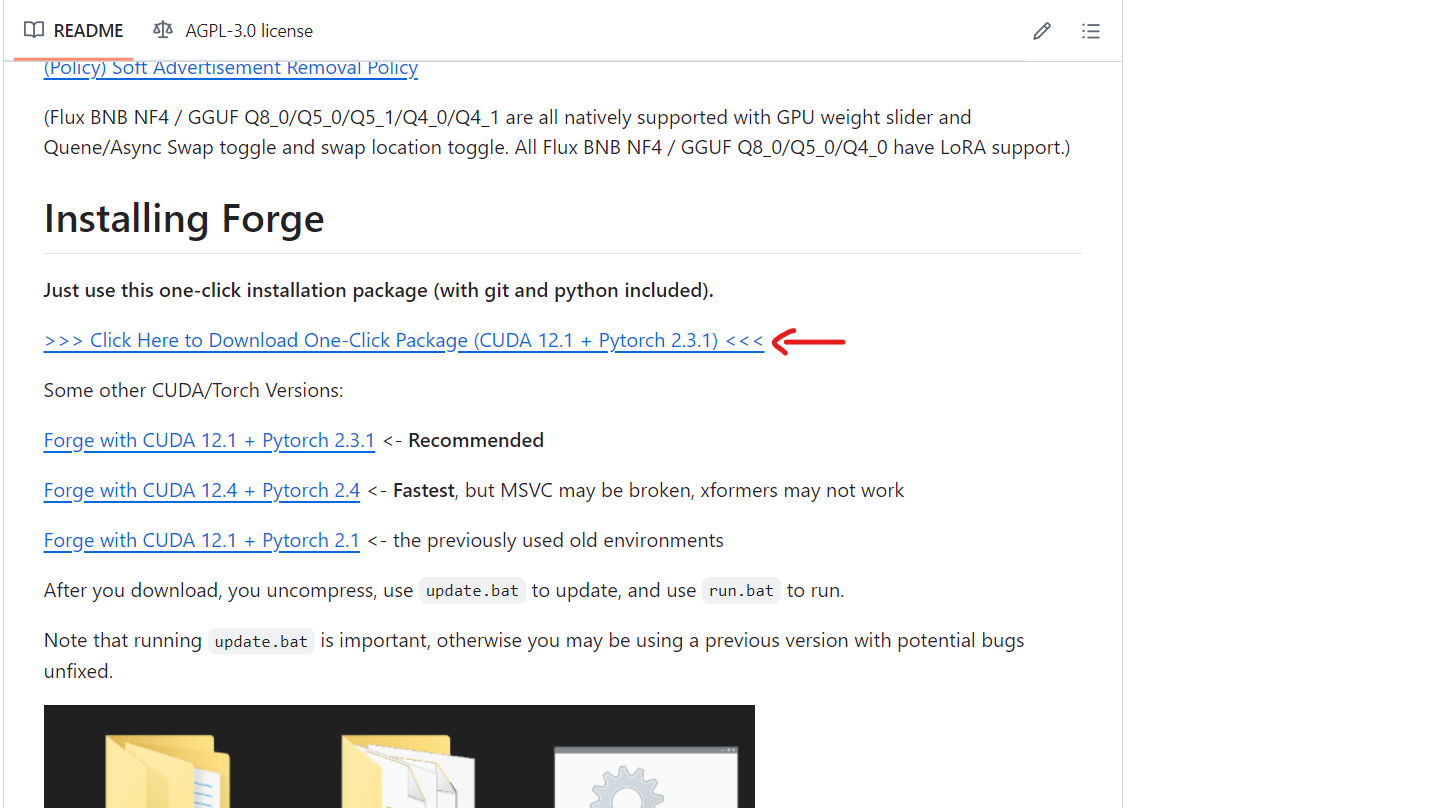

步驟一:下載並安裝 Stable Diffusion WebUI Forge

-

前往 Stable Diffusion WebUI Forge 的 Github 頁面(https://github.com/lllyasviel/stable-diffusion-webui-forge),找到一鍵安裝包的下載連結。

-

下載後解壓縮到任意資料夾中。

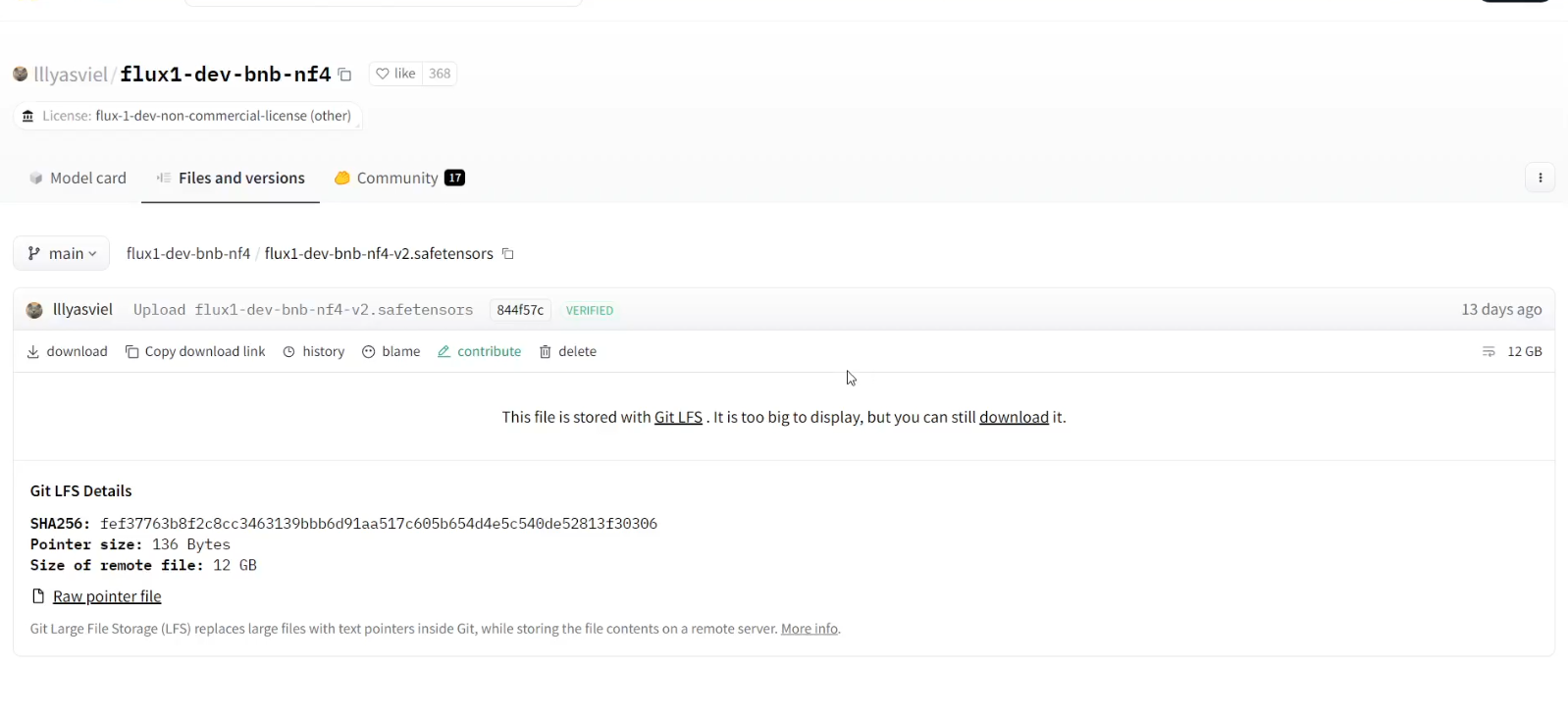

步驟二:下載 NF4 量化模型

-

前往 HuggingFace 網站,下載 lllyasviel 上傳的

flux1-dev-bnb-nf4-v2模型。(P.S.也可自行搜尋並下載 schnell 等其他模型)

-

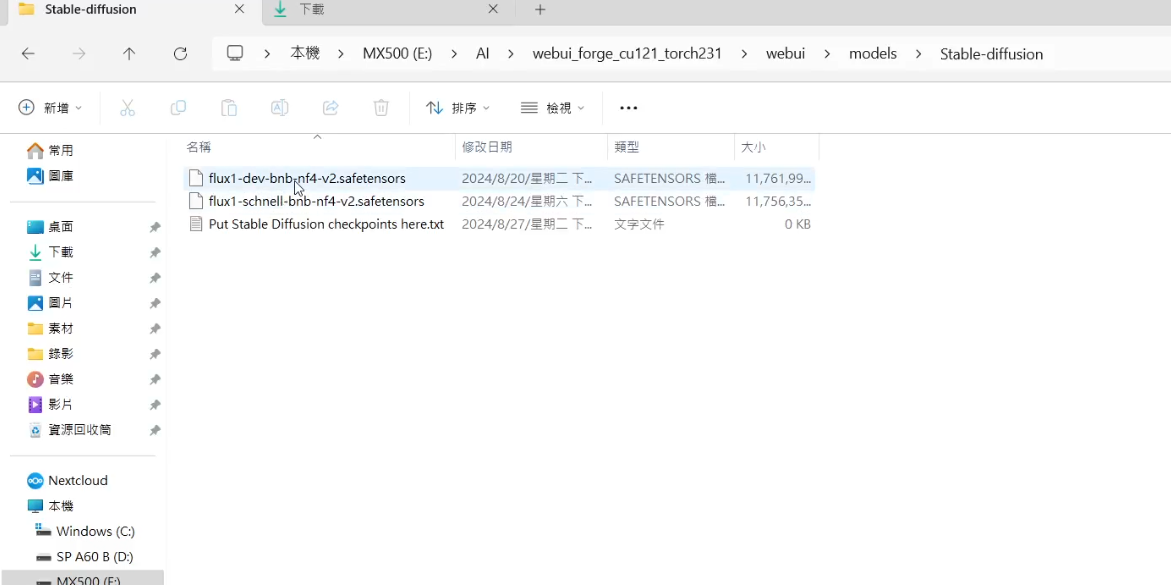

將下載的

.safetensors模型檔案放到 WebUI Forge 資料夾中的webui\models\Stable-diffusion資料夾內。

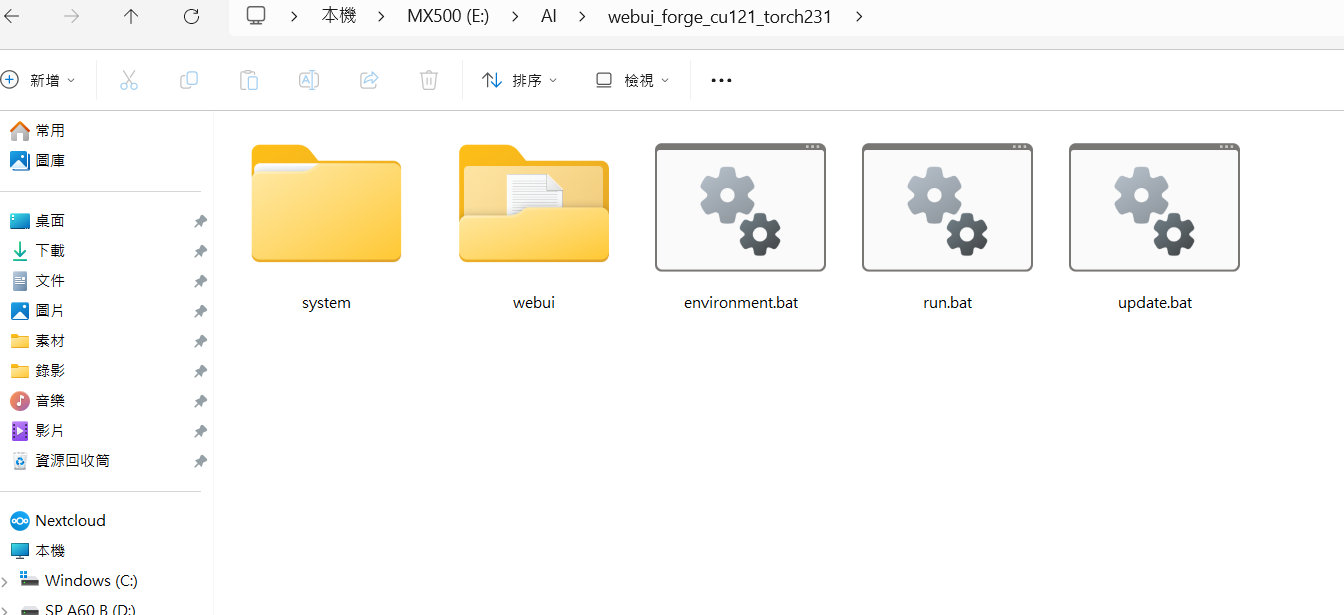

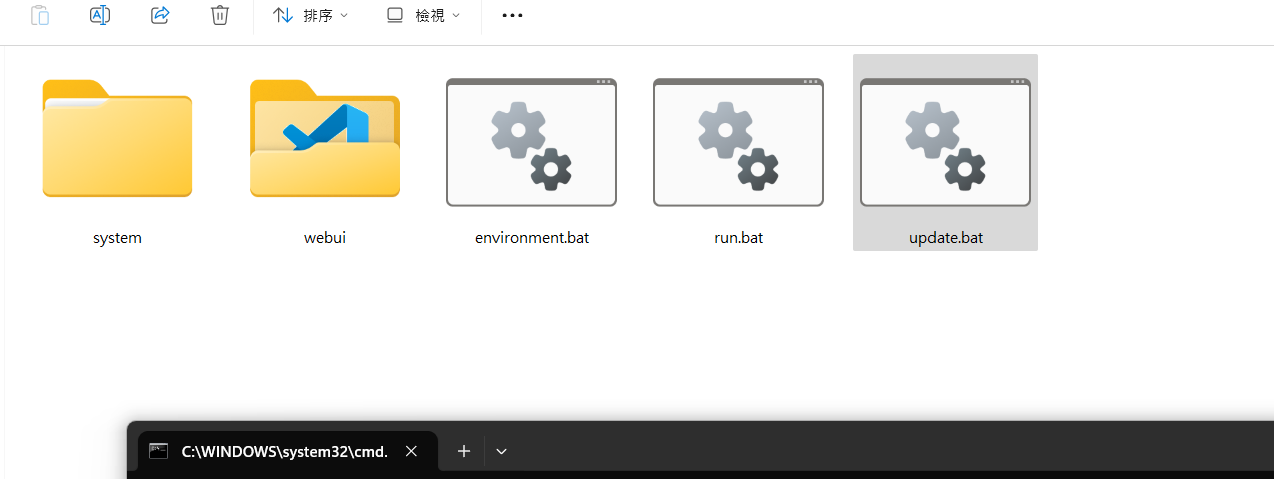

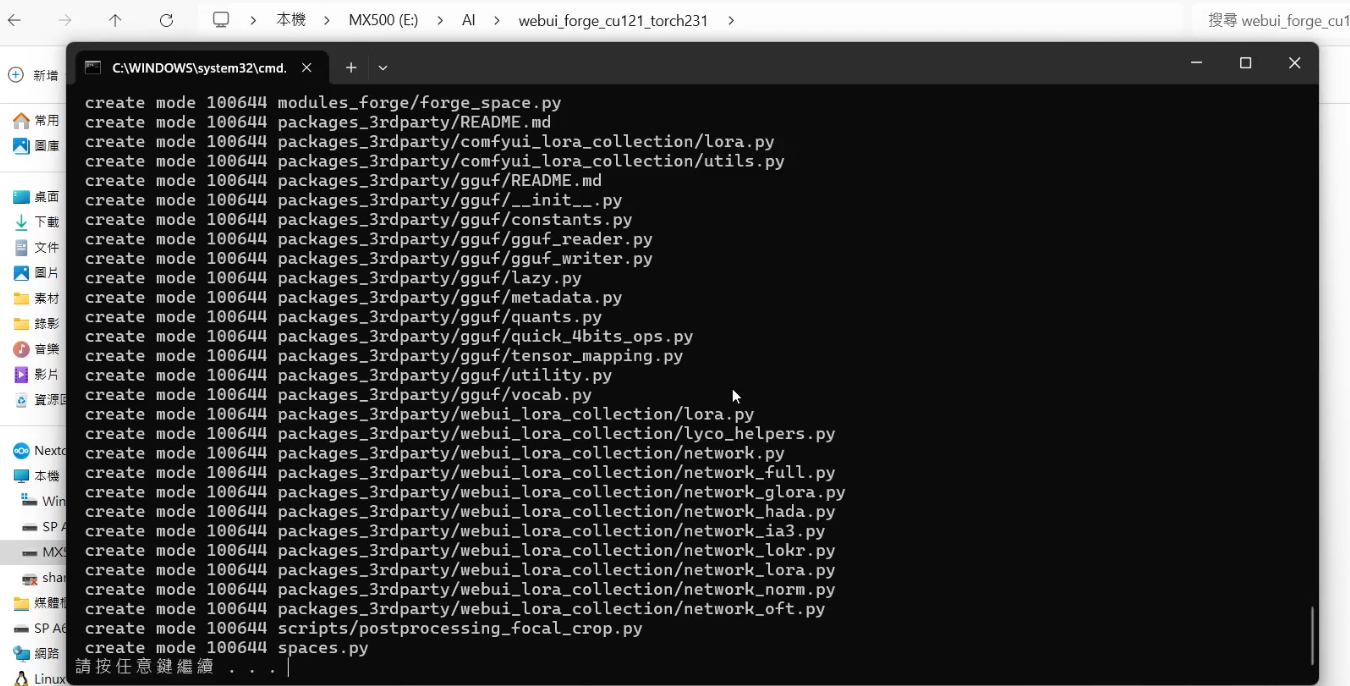

步驟三:更新 WebUI Forge

-

打開 WebUI Forge 資料夾,執行

update.bat批次檔,更新 WebUI Forge。

-

更新完成後關閉視窗。

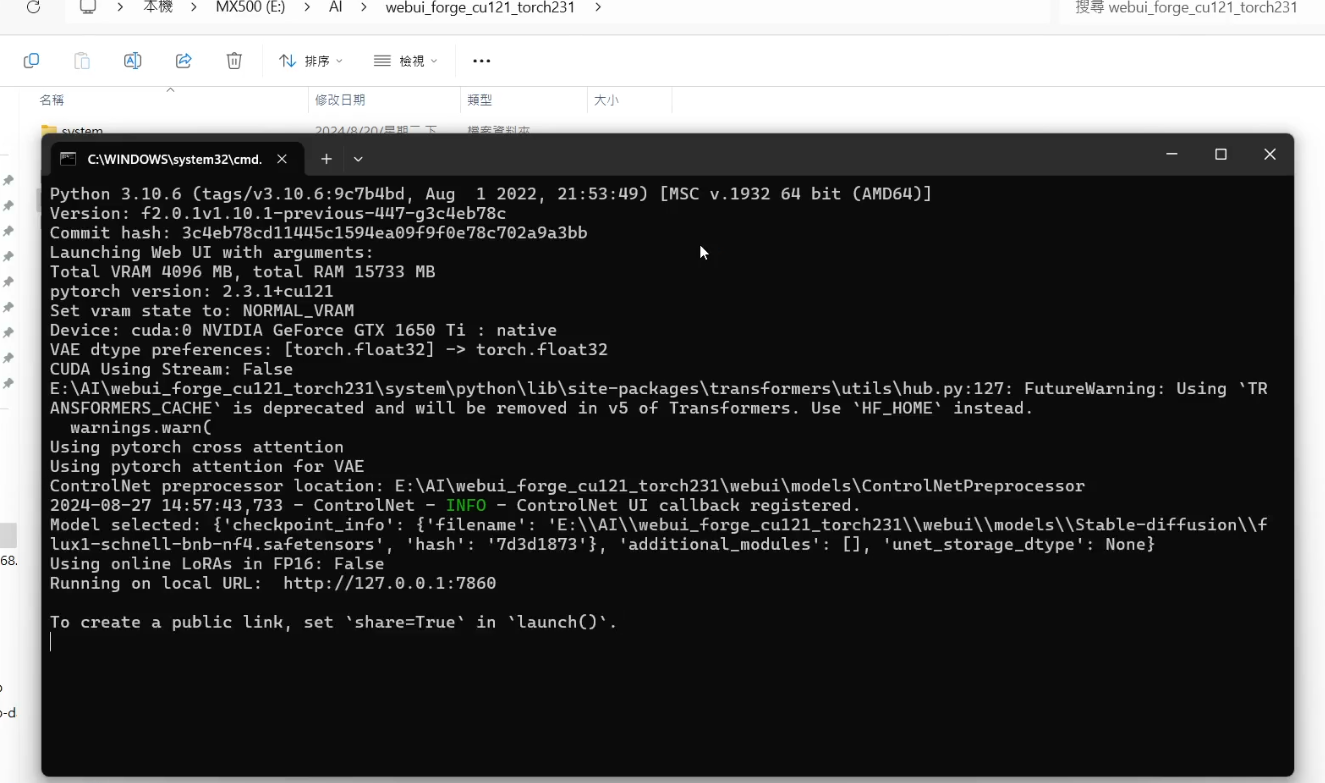

步驟四:啟動 WebUI

-

執行

run.bat批次檔,第一次執行會下載並安裝所需套件,之後啟動 WebUI 也只需要執行這個檔案。

-

等待程式執行完畢,Web UI 會自動開啟。

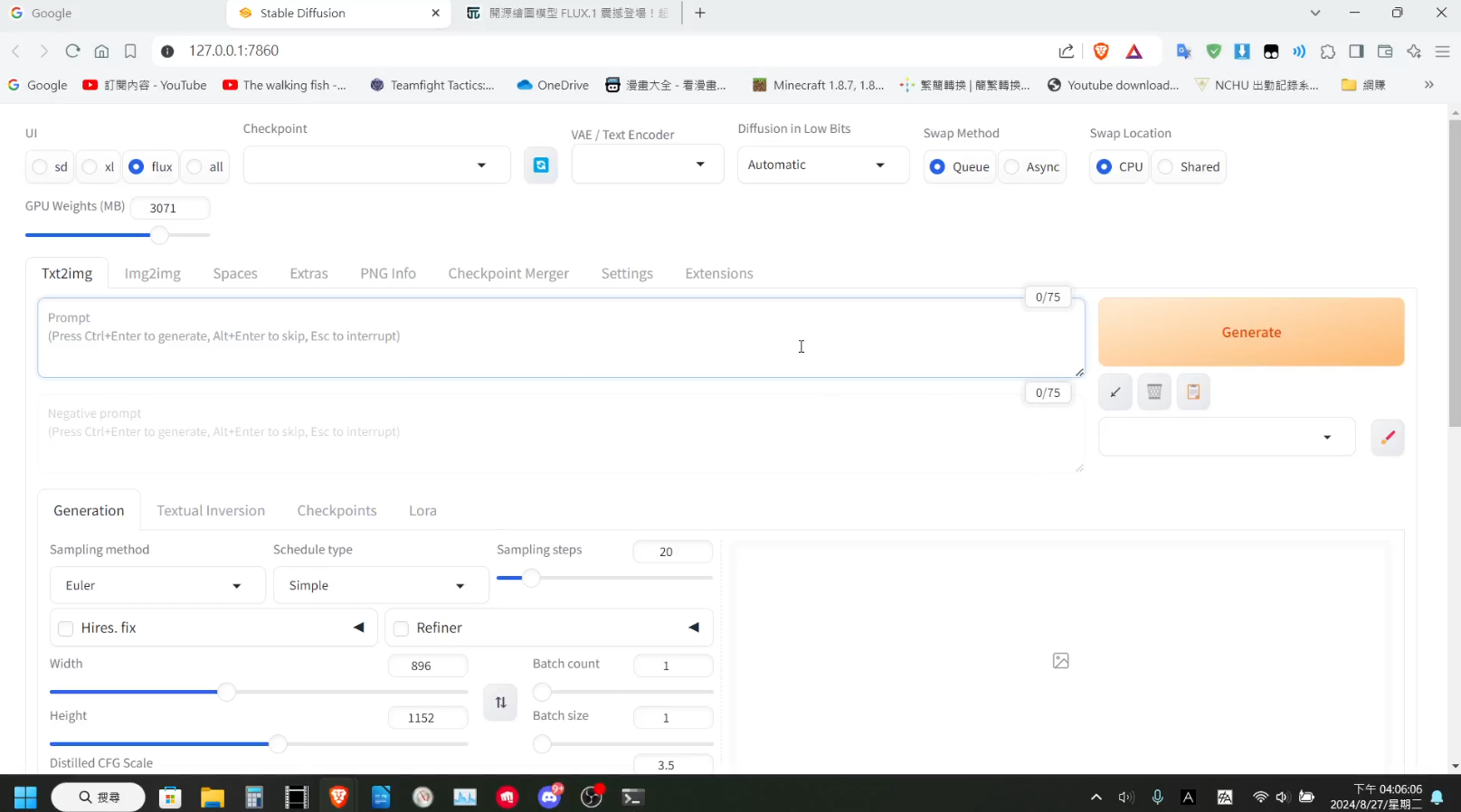

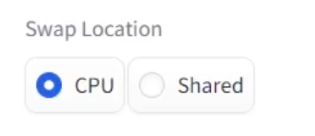

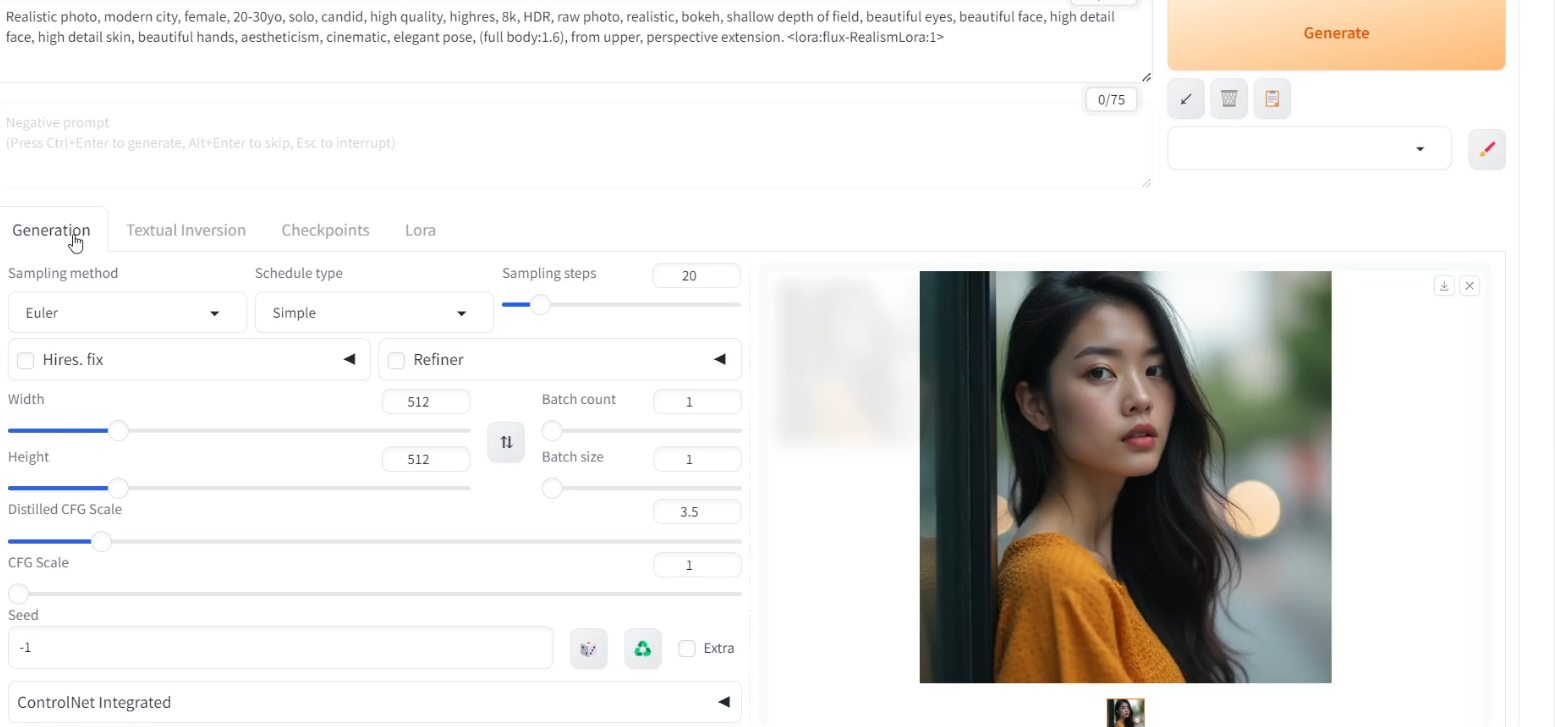

步驟五:設定 Web UI

在正式開始生圖之前,我們要先了解並調整一下設定。

-

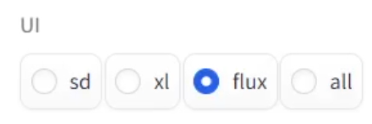

在 Web UI 左上方選擇

flux

-

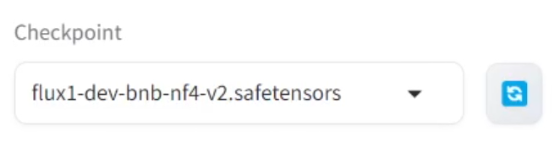

Checkpoint 選擇剛剛下載的模型 如:

flux1-dev-bnb-nf4-v2。

-

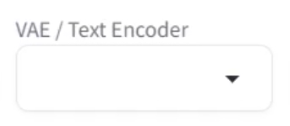

VAE / Text Encoder可以不用選擇,NF4 量化模型通常已內建。

-

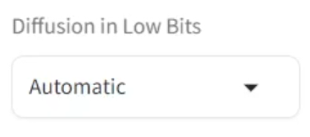

Diffusion in Low Bits保持Automatic即可,程式會自動偵測。

-

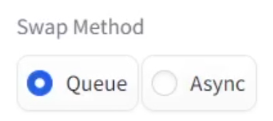

Swap Method選擇ASYNC模式,可能可以有 30% 左右的性能提升,但不穩定,可能會反而變得更漫,若只想穩定使用建議選擇Queue模式,確保穩定性。

-

Swap Location選擇Share模式,可能可以有 15% 左右的性能提升,但不穩定,可能會導致程式崩潰,一樣如果只想穩定使用建議選擇CPU。

-

GPU Weight根據生成圖片的大小調整,若生成 1024×1024 的圖片建議預留 2GB VRAM,例如顯卡有 6GB VRAM,GPU Weight就只設 4000 MB 左右。512×512 的圖片可能就預留 1GB 左右的 VRAM

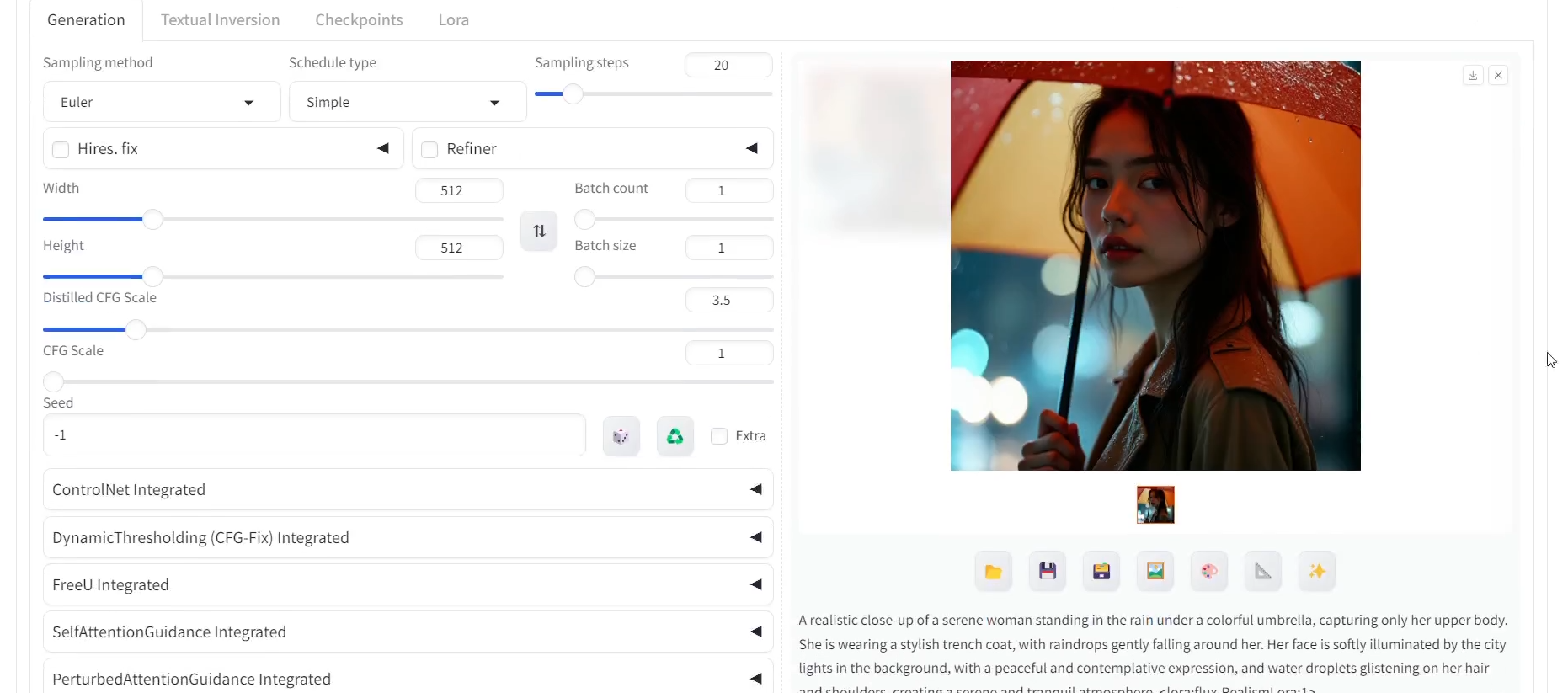

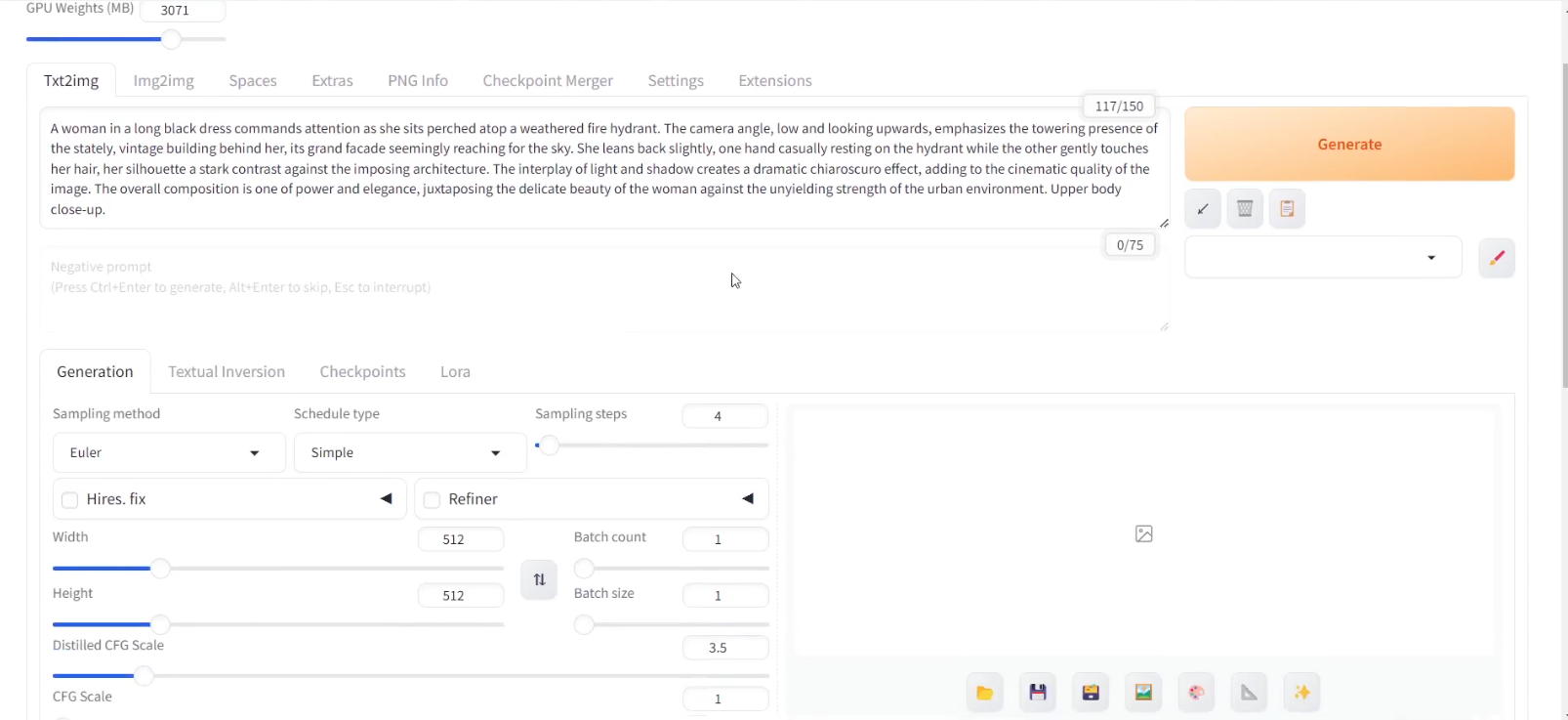

步驟六:開始生成圖片

了解完設定,我們就可以開始生成圖片了

- 在

Prompt欄位輸入想要的提示詞。 - 調整圖片解析度,若顯卡較差,可以從 512x512 開始測試,逐步提高。

Sampling Stepsdev模型可用20,若想要更精細的圖片可以調28,使用 scchnell 模型的話,則調成4。- 點擊

Generate按鈕,開始生成圖片。

大部分其他設定,基本使用的話可以不用調整,但若熟悉 WebUI 的使用者,可以自行嘗試看看調整其他參數,看看會有什麼變化。

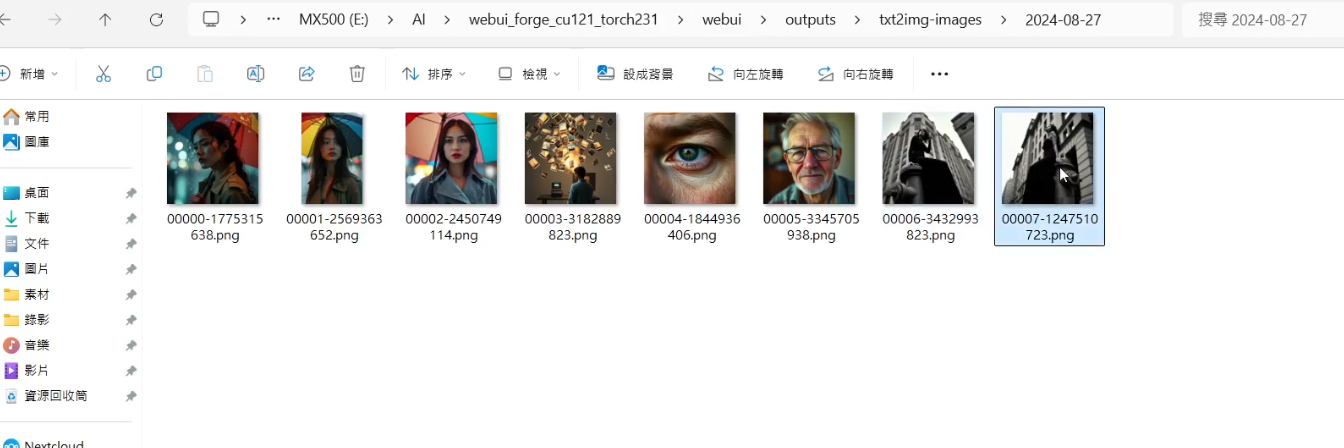

步驟七:預覽和儲存圖片

-

生成完成的圖片可以在 WebUI 中預覽。

-

所有生成的圖片都會儲存在 WebUI Forge 資料夾中的

webui\outputs資料夾內。

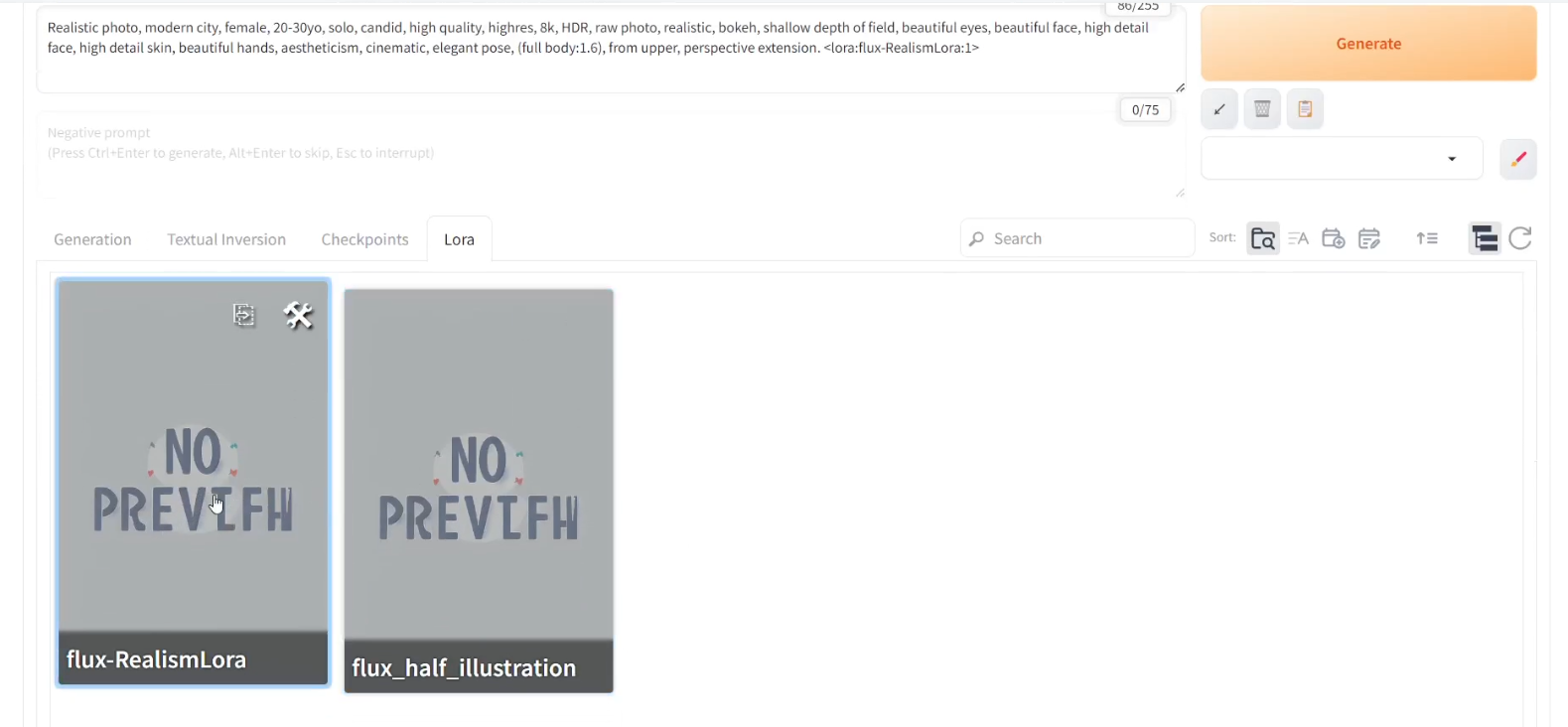

Extra: 使用 LoRA 調整圖片風格

要使用 LoRA 也很簡單,只需下載 LoRA 模型,並將其放到 webui\models\Lora 資料夾內,即可在 WebUI 中使用。

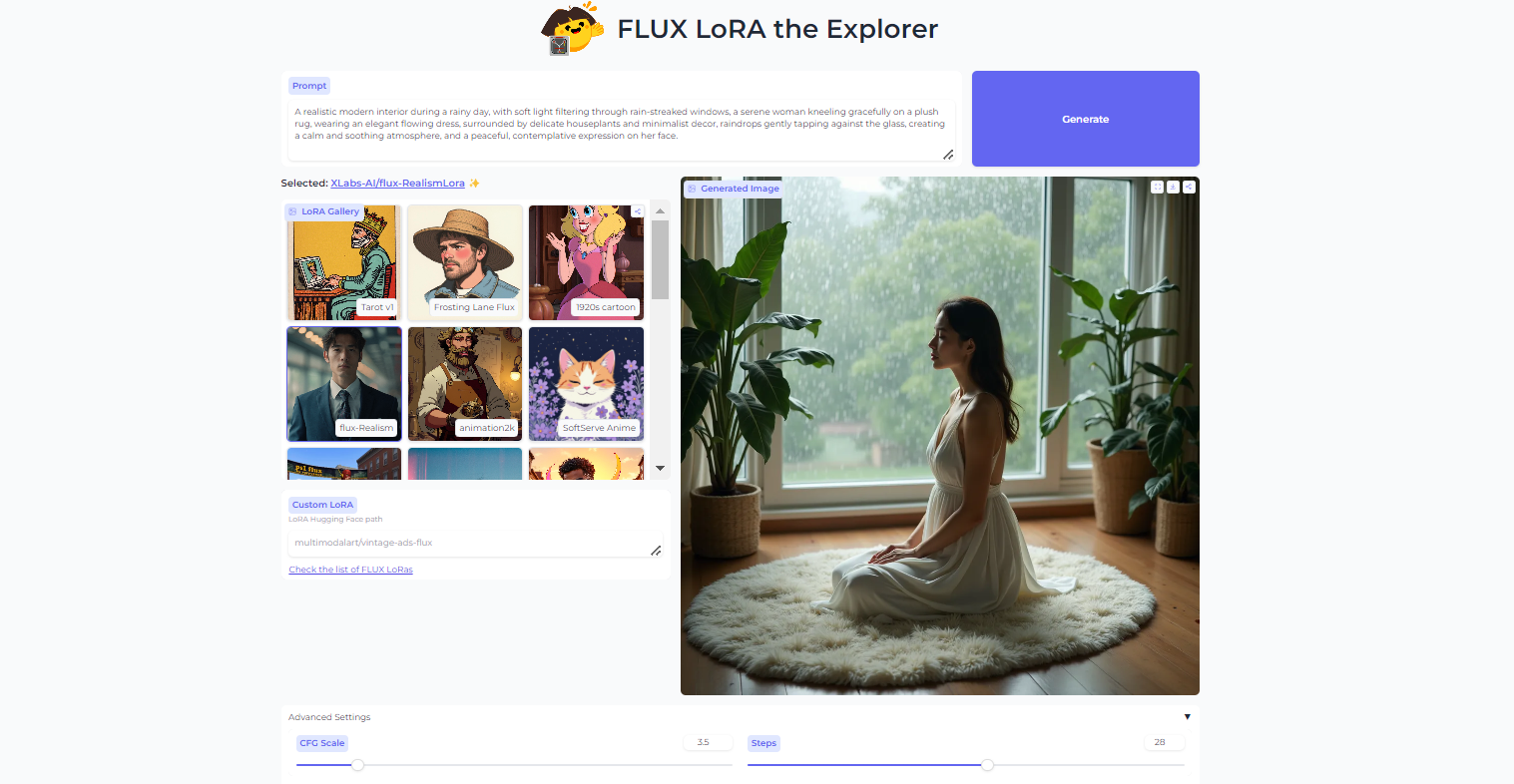

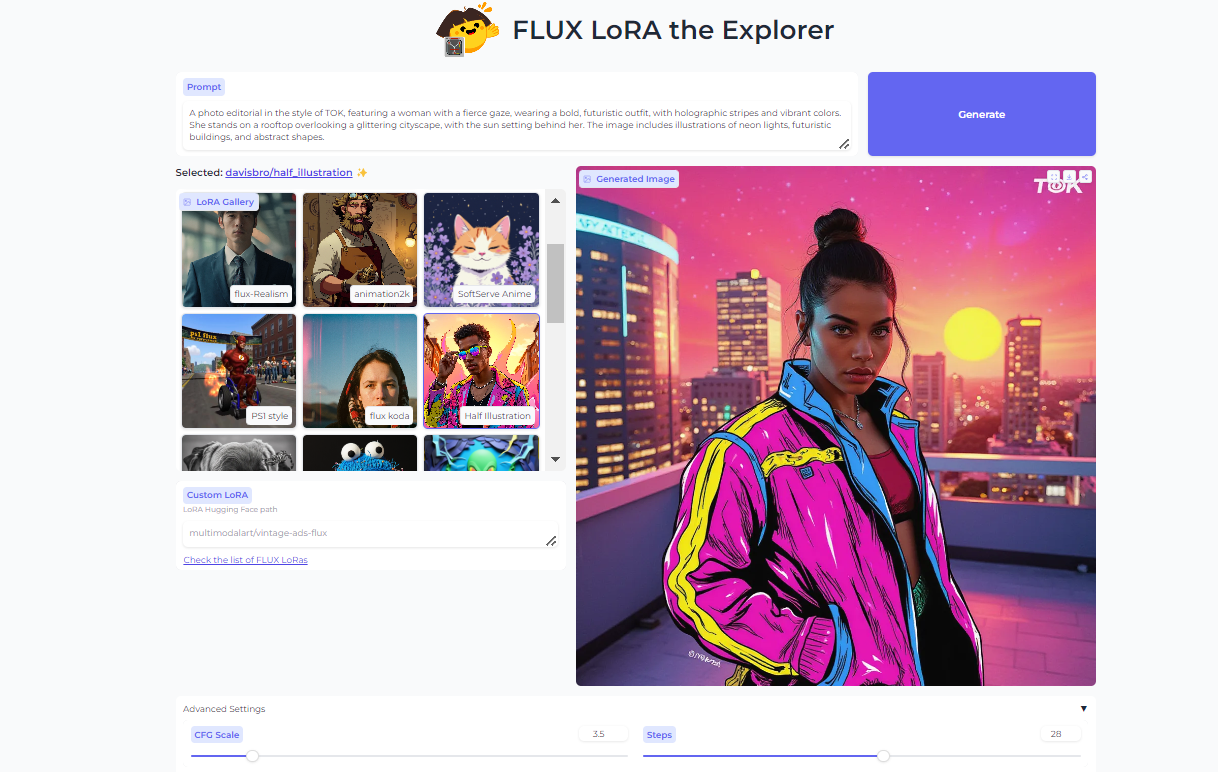

這邊也順便推薦一個 HF Space flux-lora-the-explorer,可以線上試用一些 FLUX.1 LoRA 的效果。

總結

透過以上步驟,即使只有 4GB VRAM 的顯卡,也能輕鬆體驗 FLUX.1 AI 繪圖的魅力!

其他注意事項

- 生成圖片的大小會影響到需要的 VRAM 與速度,建議根據自己的硬體效能調整。

- 可以嘗試使用 FLUX.1 schnell 模型,速度更快,但生成圖片品質略遜於 dev 模型。

- 雖然說本篇文章使用了僅有 4GB VRAM 的顯卡來執行 FLUX.1 模型,但依舊建議使用 6GB VRAM 以上的顯卡。

- VRAM 大小對生圖速度影響巨大,但依舊別忘了不同世代、級距的顯卡核心效能皆有不小差距,這也會影響生成速度。