Google 在 7 月 31 日開源了僅有 20 億參數的 Gemma 2 2B 語言模型,並同步發布了安全模型 ShieldGemma 和模型解釋工具 Gemma Scope,為 Gemma 2 系列模型增添生力軍。

這次 Gemma 2 2B 的開源,不僅代表 Gemma 2 系列模型正式完整,更重要的是它展現了小參數模型也能擁有驚人的表現。

Gemma 2 2B:小尺寸,大能力

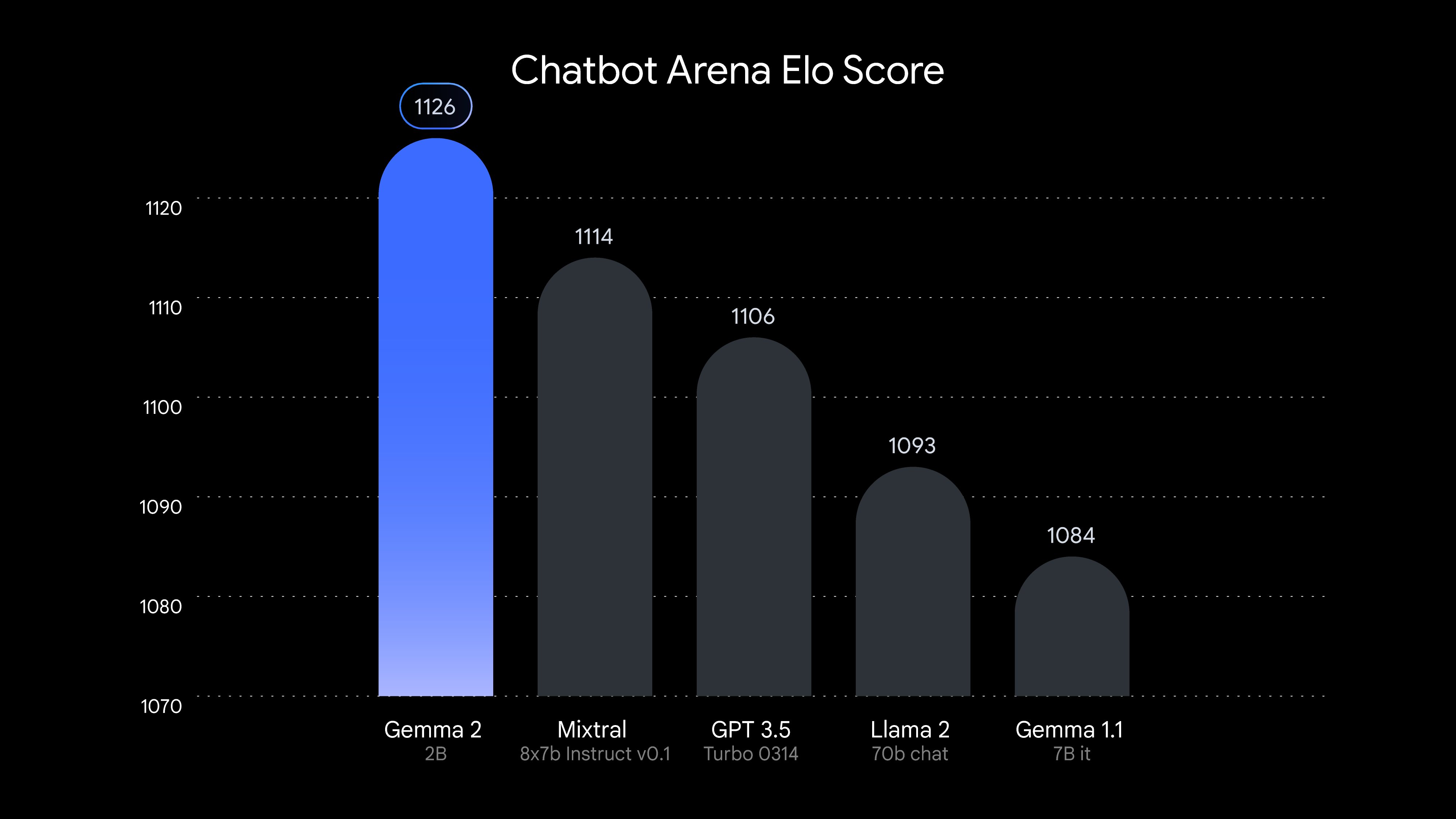

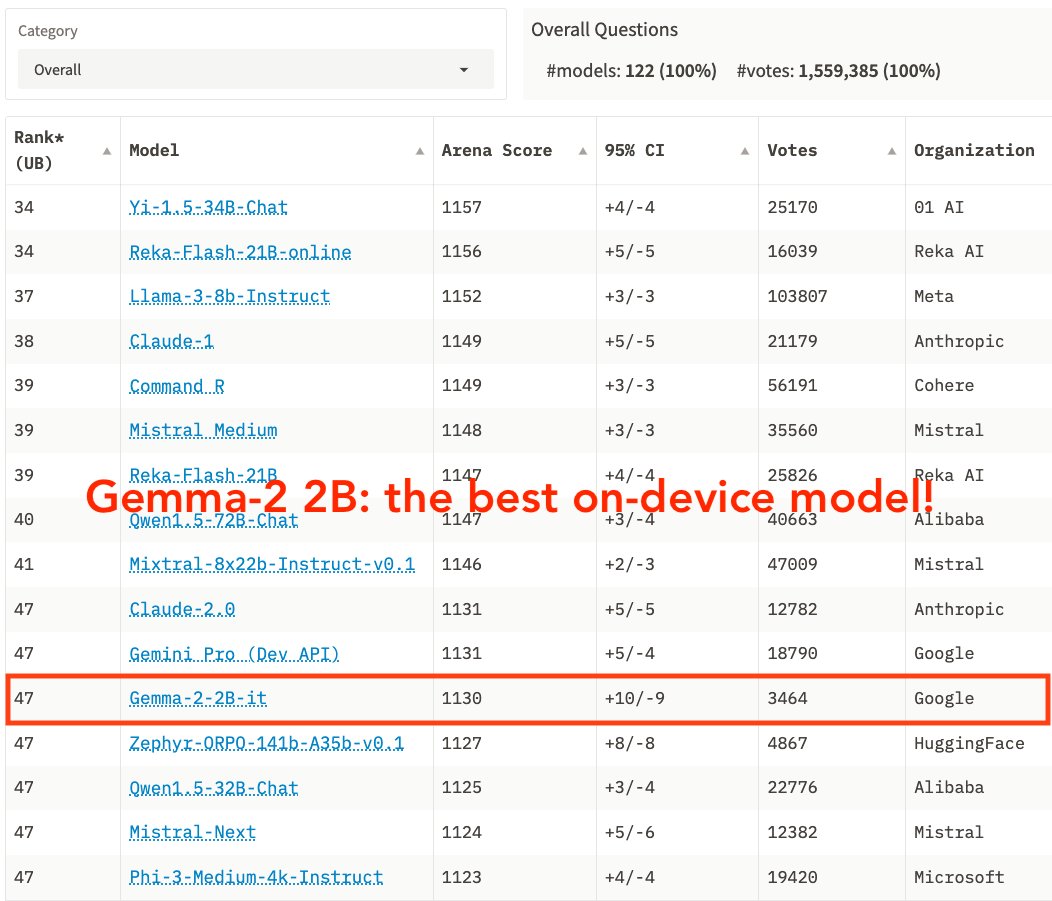

別看 Gemma 2 2B 參數量小,它的對話能力可是不容小覷,尤其是在英文聊天方面表現相當出色。根據 LMSYS 語言模型競技場 的排名,Gemma 2 2B 的表現甚至超越了 GPT-3.5-Turbo-0314!

從上圖可以看出,Gemma 2 2B 不僅超越了所有 GPT-3.5 模型,更僅以 2B 的參數量超越了 Mixtral 8x7B 和 Llama 2 70B 等參數量大它 10 倍以上的開源語言模型。

Gemma 2 2B 之所以能有如此亮眼的成績,主要歸功於 Gemma 2 系列 27B 大模型的優異表現,透過知識蒸餾訓練,讓 Gemma 2 2B 能夠在有限的參數量下,展現出色的語言能力。

Gemma 2 2B 與其他模型的比較

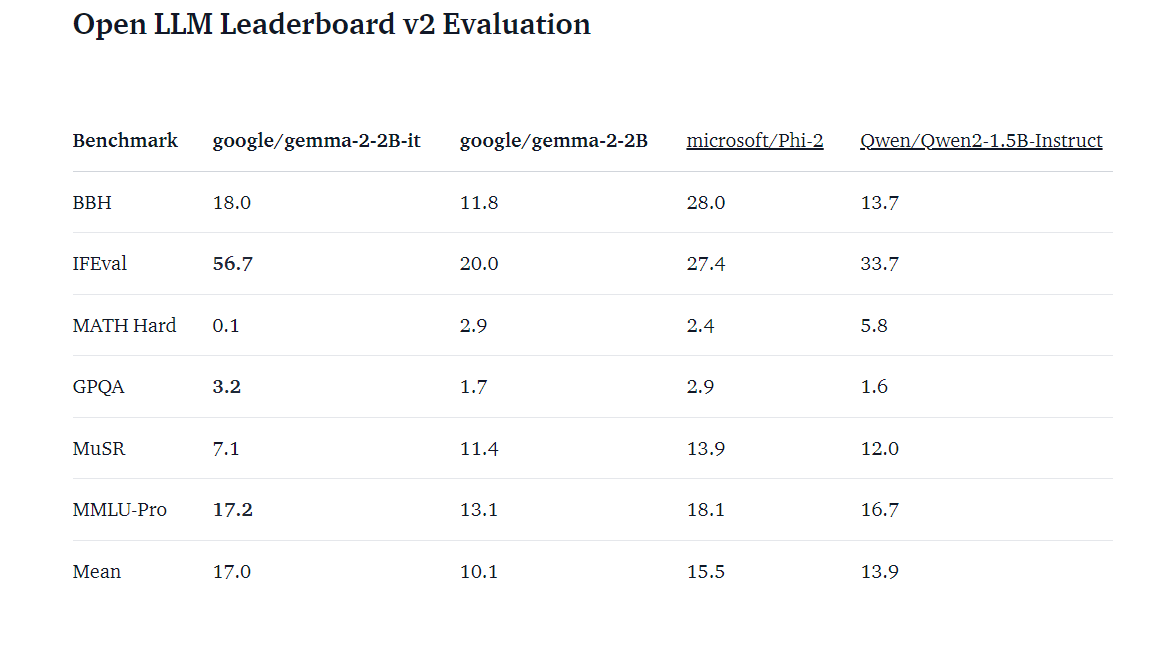

除了 LMSYS 的評測外,OpenLLM 的資料也顯示 Gemma 2 2B 在與其他參數量相近的開源語言模型(如 Microsoft Phi-2 和 Qwen2-1.5B-Instruct)相比,在 IFEval 分數上有著明顯的優勢。

Gemma 2 2B 在個人裝置的可用性

Gemma 2 2B 的參數量小,代表它對硬體的需求更低,可以在大部分個人電腦上執行,甚至經過量化後,還能在手機上運行。

Google 亦將 Gemma 2 2B 針對 NVIDIA 的 TensorRT-LLM 進行了優化,使其在雲端、個人電腦和邊緣裝置上都能順暢運行。

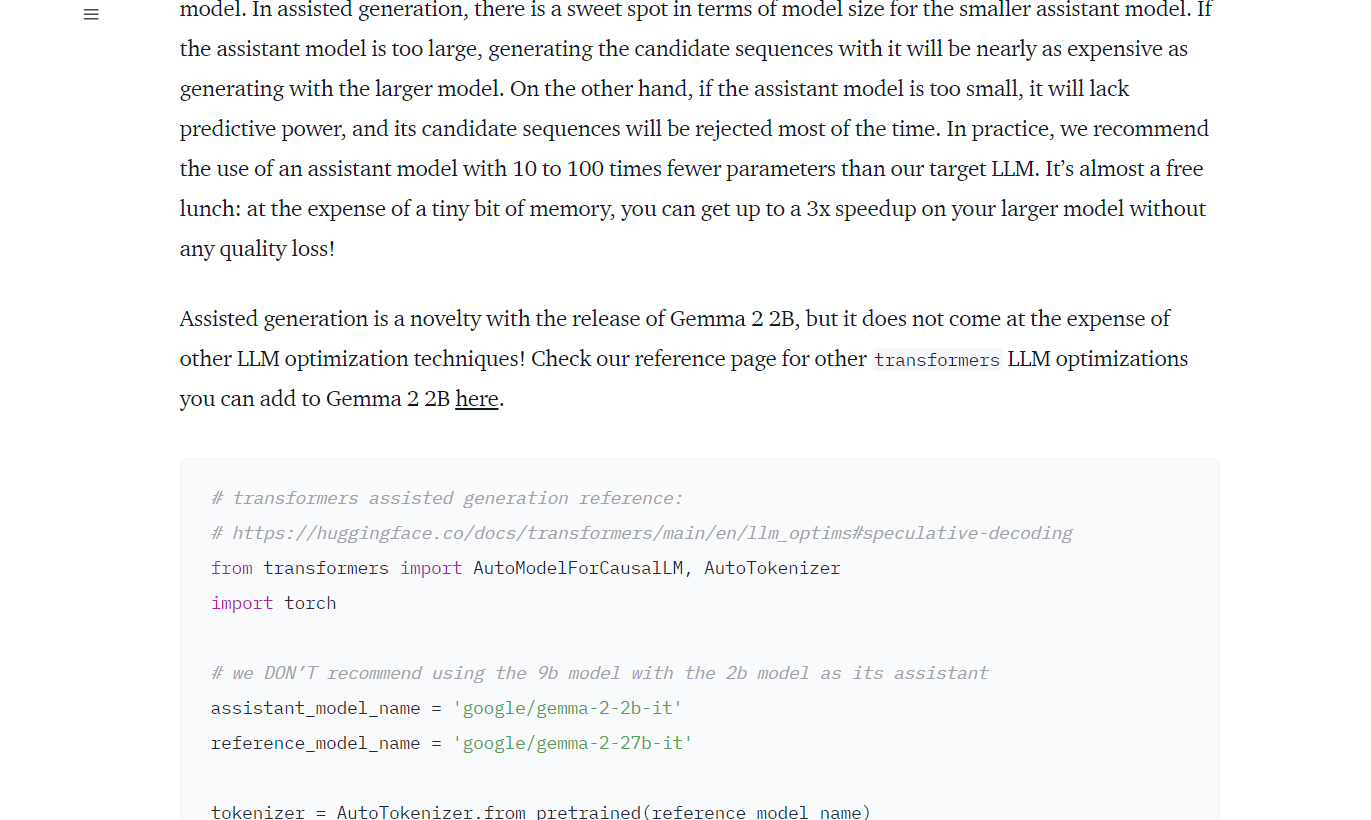

除此之外,Gemma 2 2B 還支援 Speculative Decoding(輔助生成)技術,可以作為預測模型,加速模型在伺服器上的文字生成速度。

根據 Hugging Face 的資料,使用 Gemma 2 2B 做輔助生成,可以讓 Gemma 2 27B 的生成速度最高提升 3 倍。

如何免費使用 Gemma 2 2B?

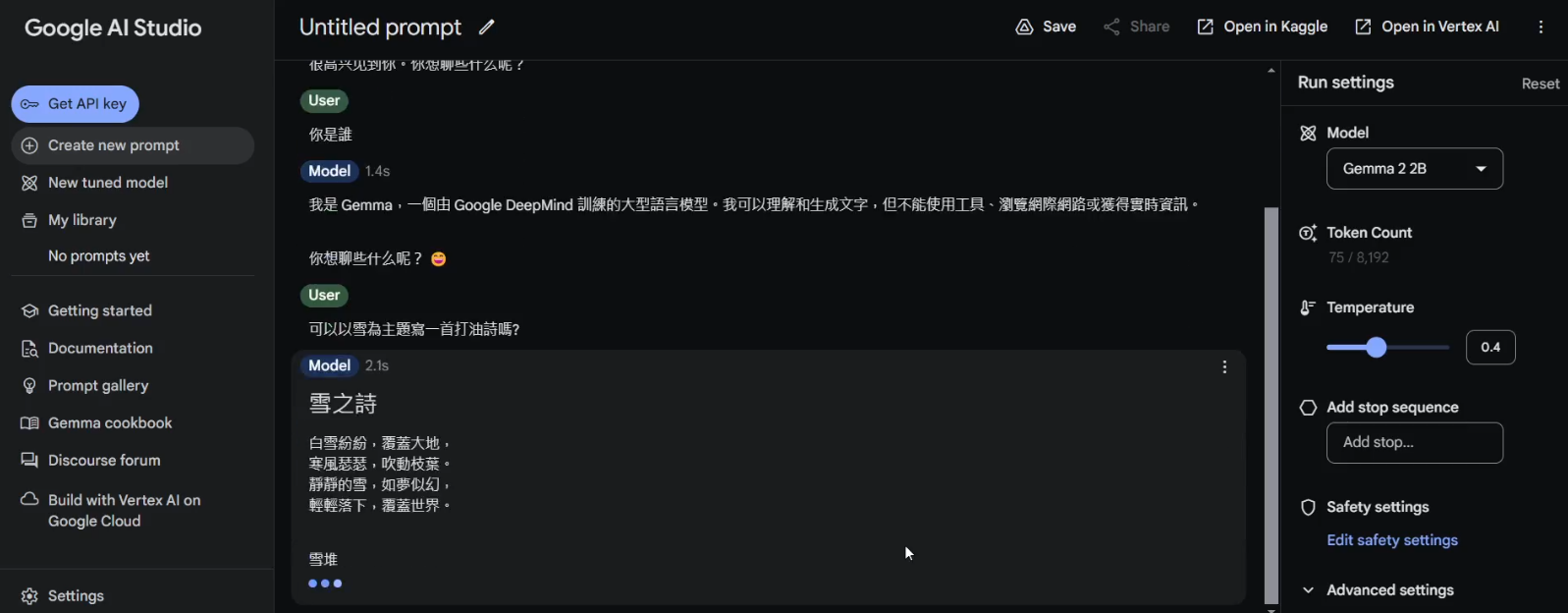

1. Google AI Studio:

作為 Google 自家的模型,Gemma 2 2B 已經可以在 Google AI Studio 上免費使用。

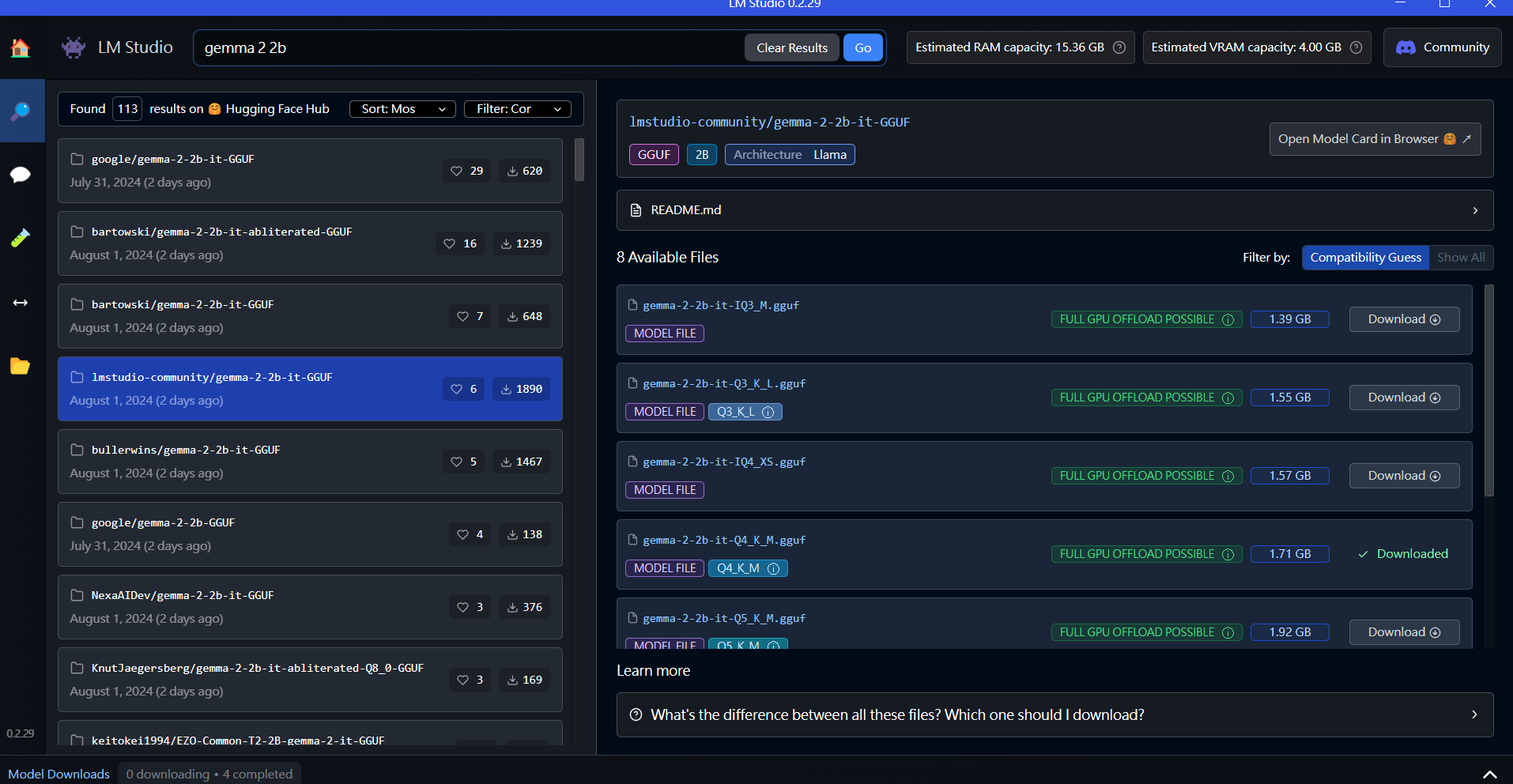

2. 使用 llama.cpp 的各種專案:

llama.cpp 也支援 Gemma 2 模型,可以使用 LM Studio 等專案執行。

之前介紹過 LM Studio 的文章:

https://the-walking-fish.com/p/lmstudio/

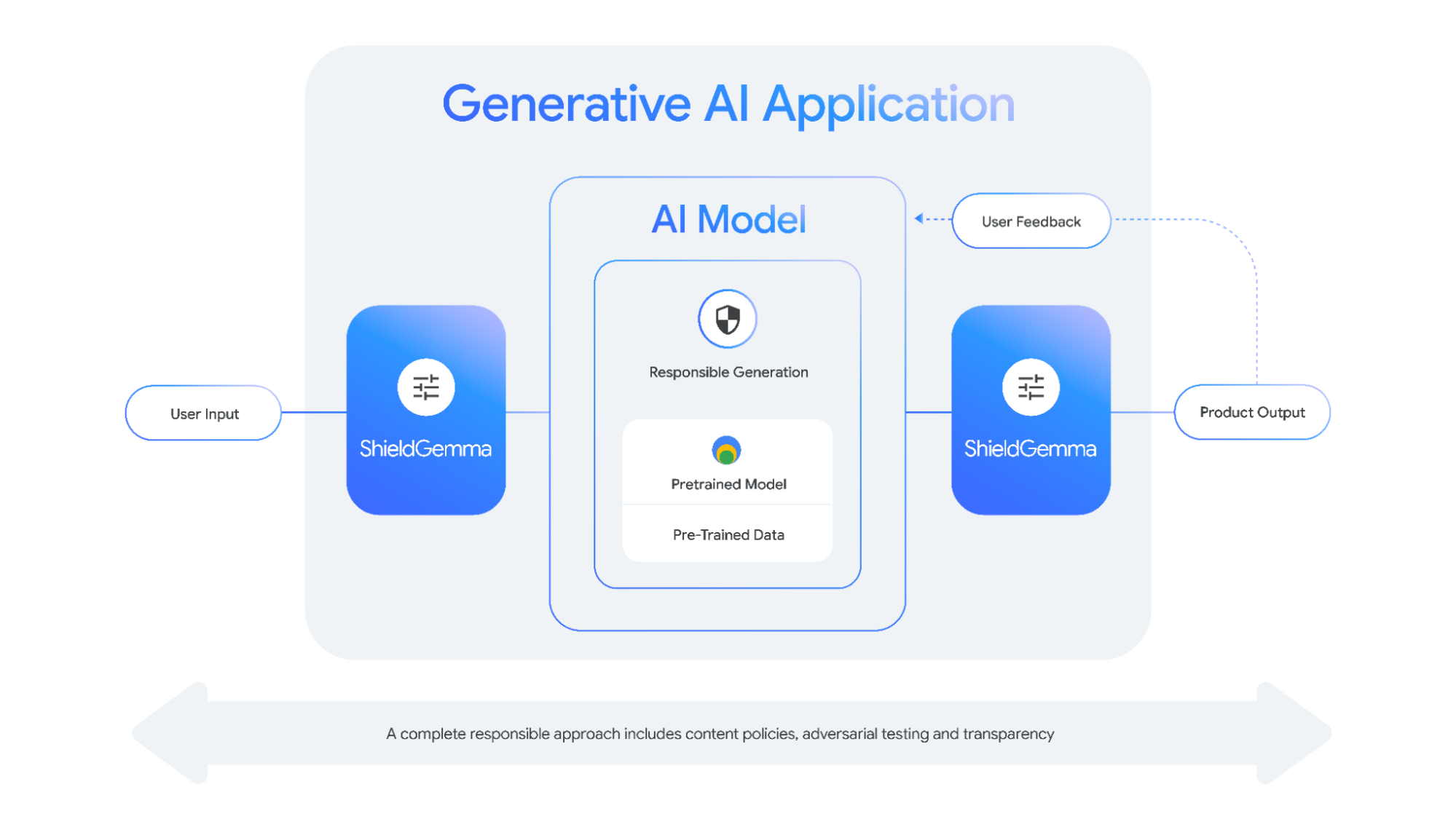

ShieldGemma:守護模型安全的利器

除了 Gemma 2 2B 之外,Google 還推出了 ShieldGemma 安全模型,類似 Meta 的 Llama Guard,可以用來偵測語言模型的不當請求和不當回應。

ShieldGemma 目前主要針對仇恨言論、騷擾、露骨內容和危險內容這四個領域進行設計,並依照模型規模分為 2B、9B、27B 三種大小。

Gemma Scope:深入模型內部的探測器

Gemma Scope 是一個基於 SAE(稀疏自編碼器)的模型解釋工具,Google 在 Gemma 2 9B 和 2B 的每一層及子層輸出上,訓練了超過 400 個 SAE,試圖解釋 Gemma 2 模型的內部行為。

研究人員未來可能可以使用 Gemma Scope 來了解模型為何會產生幻覺等問題,並藉此解決模型中的偏差。

目前,我們可以透過 Neuronpedia(https://www.neuronpedia.org/gemma-scope#main) 來試用這個技術。

總結

Gemma 2 2B 的推出,證明了小參數模型也能擁有出色的表現,而 ShieldGemma 和 Gemma Scope 的發布,則展現了 Google 在模型安全和模型解釋方面的努力。相信在未來,Gemma 2 系列模型將在各個領域發揮更大的作用。